2.4.3 Das Lektüremodell der Generativen Grammatik

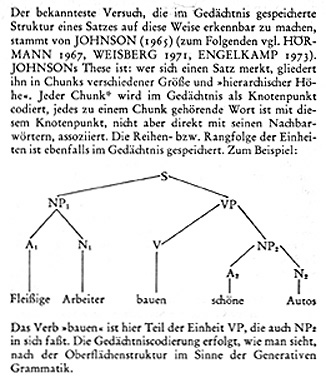

Auszug aus: Hörmann (1976), S. 447.

Auszug aus: Hörmann (1976), S. 447.

Der hier zugrundegelegten Hypothese zufolge wird ein Sprecher, der ein bestimmtes Wort (z.B. "Arbeiter") erinnert, bestimmte andere Wörter (z.B. "fleißige" oder "bauen") mit einer Wahrscheinlichkeit erinnern, die der Häufigkeit ihrer Verknüpfung mit Chunk-Knoten entspricht. So wird er z.B. "fleißig" sehr viel wahrscheinlicher erinnern als "bauen", da "bauen" nur über den höchstgelegenen Knoten S mit N1 ("Arbeiter") verbunden ist, während "fleißig" schon über NP1 mit "Arbeiter" zusammenhängt.

Dass solche Modelle in den 1980er Jahren eine Hochkonjunktur hatten, liegt an der in dieser Zeit aufgekommenen Computereuphorie: Man glaubte, die mentalen Vorgänge beim Verstehen von Sprache mit Computer-Algorithmen wie solchen Baumstrukturen (andere arbeiten mit sog. "Frames", wieder andere mit "Scripts") nachbilden zu können. Doch die mit viel Optimismus und Aufwand betriebenen Forschungen zur "Künstlichen Intelligenz" (KI) endeten kleinlaut. Man hatte die Komplexität der für das Verstehen menschlicher Sprache erforderlichen Prozesse unterschätzt – insbesondere die schon von Ludwig Wittgenstein hervorgehobene Tatsache, dass die Bedeutung eines Worts sich aus ihrem Gebrauch in konkreten lebensweltlichen Situationen ergibt und deshalb unmögllich nach festgelegten Regeln ermittelt werden kann: We "make up the rules as we go along" (1953, S. 67).